„Locally AI joins LM Studio“

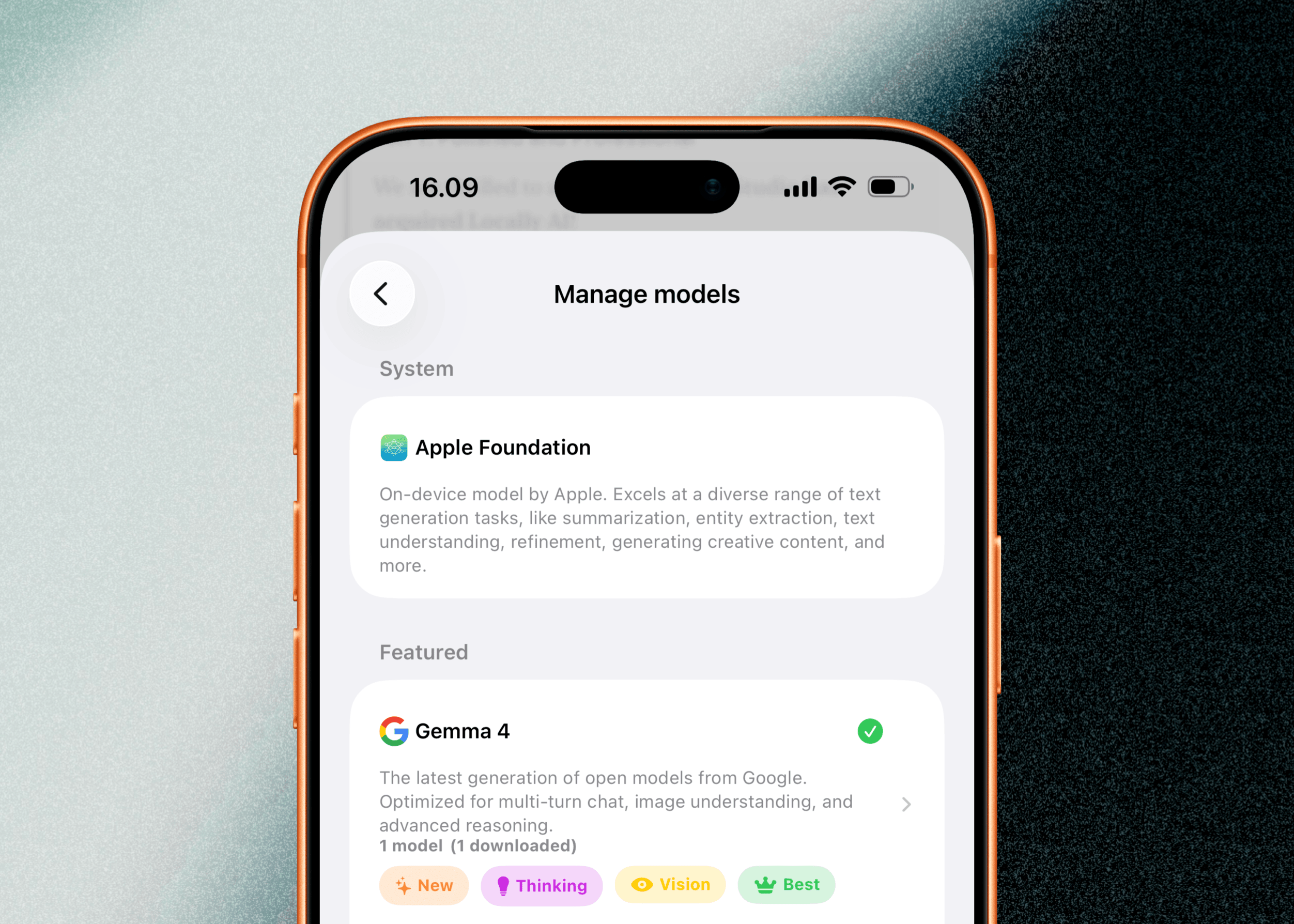

Mit dem Release von Gemma 4 wollte ich erst kürzlich noch einmal über Locally AI schreiben. Diese One-Man-Show für On-Device-AI stellte wieder umgehend, nur wenige Stunden nach der Veröffentlichung, Googles neuestes Open-Source-LLM als Download in seiner übersichtlichen Software bereit.

In dieser Woche bekam ich einen noch triftigeren Grund für eine abermalige Erwähnung:

We are excited to announce that LM Studio has acquired Locally AI!

Adrien Grondin, the talented creator of the Locally AI apps, will be joining the LM team to lead our work on native AI experiences across your devices.

Mit der Erstellung von ALT-Text und einer automatischen Dateibenennung habe ich für mich zwei einzelne Anwendungsfälle für lokale AI gefunden; alles andere läuft besser, schneller und günstiger mit einem Gemini-, ChatGPT- oder Claude-Abo – wenn auch ohne Datenschutz und Vertraulichkeit.

Auf absehbare Zeit scheint es eine gute Wette, dass allen unseren greifbaren Computern die Rolle als „Thin Client“ zugeschrieben bleibt.

Es wäre jedoch nicht das erste Mal, dass AI vermeintlich absehbare Zeitpläne torpediert, etwa mit leistungsfähigen Small Language Models, und Features bietet, die am besten tief eingeflochten in andere Software und auf Betriebssystemebene funktionieren.